用GPU建資料中心太貴? 輝達黃仁勳:買越多、省越多

IC 設計大廠輝達 (NVDA-US) 執行長黃仁勳今 (29) 日在 COMPUTEX 舉辦主題演講,內容圍繞人工智慧 (AI),除推出最新 GH200 超級晶片,也比較資料中心成本架構,直言以 GPU 建置的資料中心將遠低於 CPU,強調買越多、省越多 (The more you buy, the more you save.)。

黃仁勳指出,儘管 CPU 過去幾年運算速度不斷提升,但進入 AI 時代後,以 CPU 為運算基礎的時代已經結束,現在大型語言模型 (LLM) 需要更新的解決方案。

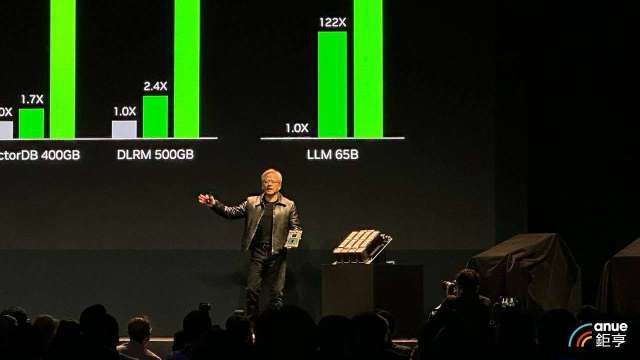

黃仁勳舉例,假設建置資料中心預算為 1000 萬美元,可以選擇建置 1 座搭載 960 顆 CPU、功耗達 11GW 的資料中心,抑或是選擇建置 1 座有 48 顆 GPU、功耗僅需 3.2GW 的資料中心,且 LLM 資料處理量是 CPU 的 44 倍。

黃仁勳也更換比較基準,若以處理同樣資料量的大型語言模型 (LLM) 來看,可以選擇斥資 1000 萬美元,建置 1 座搭載 960 顆 CPU、功耗達 11GW 的資料中心,抑或是選擇只花費 40 萬美元,建置 1 台需要 2 顆 GPU、功耗僅需 0.13GW 的資料中心。

因此,黃仁勳也語帶詼諧指出,GPU 將為客戶省好多錢,直言買越多、省越多,後續也在介紹 AI 時,透過語音輸入指令,請 AI 幫忙創作歌曲、歌詞等,更將現場變成大型卡拉 OK 包廂,邀請現場觀眾與他一起唱出 AI 的創作。

輝達此次在會中推出最新 DGX GH200 AI 超級電腦,透過搭載 Grace Hopper 超級晶片與 NVLink Switch System,將協助客戶生成式 AI 語言應用、推薦系統及資料分析工作負載,開發巨型的下一代模型。